SEO lernen für Programmierer: Der Guide für echte Techies

In 30 Sekunden

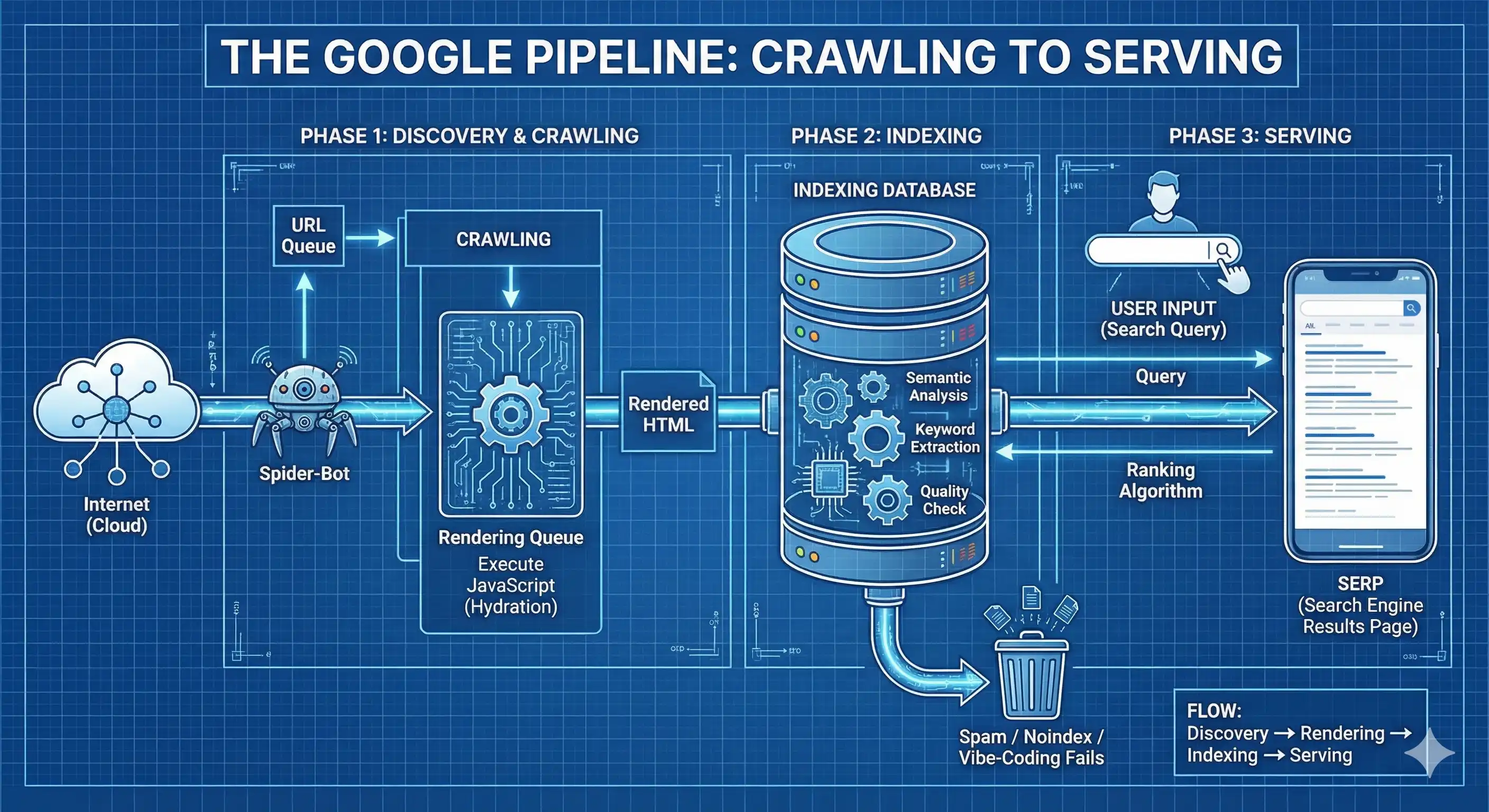

- Der Prozess: Google arbeitet in drei Phasen – Crawling (Entdecken), Indizierung (Verstehen) und Serving (Ausliefern).

- Die Technik: Nutze

robots.txtzur Crawl-Steuerung undJSON-LD(Schema.org), um Google maschinenlesbare Fakten über dein Produkt zu liefern. - Die Semantik: Ersetze "Div-Suppe" durch echtes HTML5 (

<main>,<article>) – das verbessert SEO und erfüllt gesetzliche Accessibility-Standards (BFSG 2025). - Die Autorität: Als Coder baust du Backlinks durch "Assets" – Micro-Tools, NPM-Pakete oder API-Integrationen sind stärker als jeder Kalt-Outreach.

Google unter der Haube: Wie die Suchmaschine Deine Website liest und einordnet

Google arbeitet nicht durch Magie, sondern durch schiere Rechenleistung. Drei Prozessphasen entscheiden darüber, ob deine Inhalte im digitalen Nirgendwo verschwinden oder auf der ersten Seite glänzen.

- Crawling: Der Googlebot, ein automatisiertes Programm, durchkämmt das Netz ohne Pause. Er folgt Links wie digitalen Brotkrumen. Findet er eine neue URL oder eine Änderung auf einer bestehenden Seite, liest er den Quelltext aus. Jede Aktualisierung landet sofort auf seinem Radar.

- Indizierung: Hier findet die eigentliche Analyse statt. Google speichert die Seite in einer gigantischen Datenbank. Die Suchmaschine interpretiert Layouts, analysiert die Bedeutung von Begriffen und erkennt, welches Problem eine Seite tatsächlich löst. Erst wenn die Seite verarbeitet wurde, existiert sie offiziell für die Suche.

- Serving: Sucht ein Nutzer nach einer Antwort, filtert Google Milliarden von Einträgen in Millisekunden. Relevanz ist hier kein starrer Wert. Die Algorithmen gewichten die Ergebnisse individuell nach Standort, Endgerät und Intention.

Sichtbarkeit entsteht dort, wo technisches Verständnis auf die exakte Erwartungshaltung des Suchenden trifft. Wer diese Infrastruktur versteht, hört auf zu raten und beginnt zu steuern.

Infografik wie Google funktioniert. Grafik mit Gemini Pro erstellt.

Infografik wie Google funktioniert. Grafik mit Gemini Pro erstellt.

Volle Kontrolle über Deinen Index: So steuerst Du Crawling und Sichtbarkeit

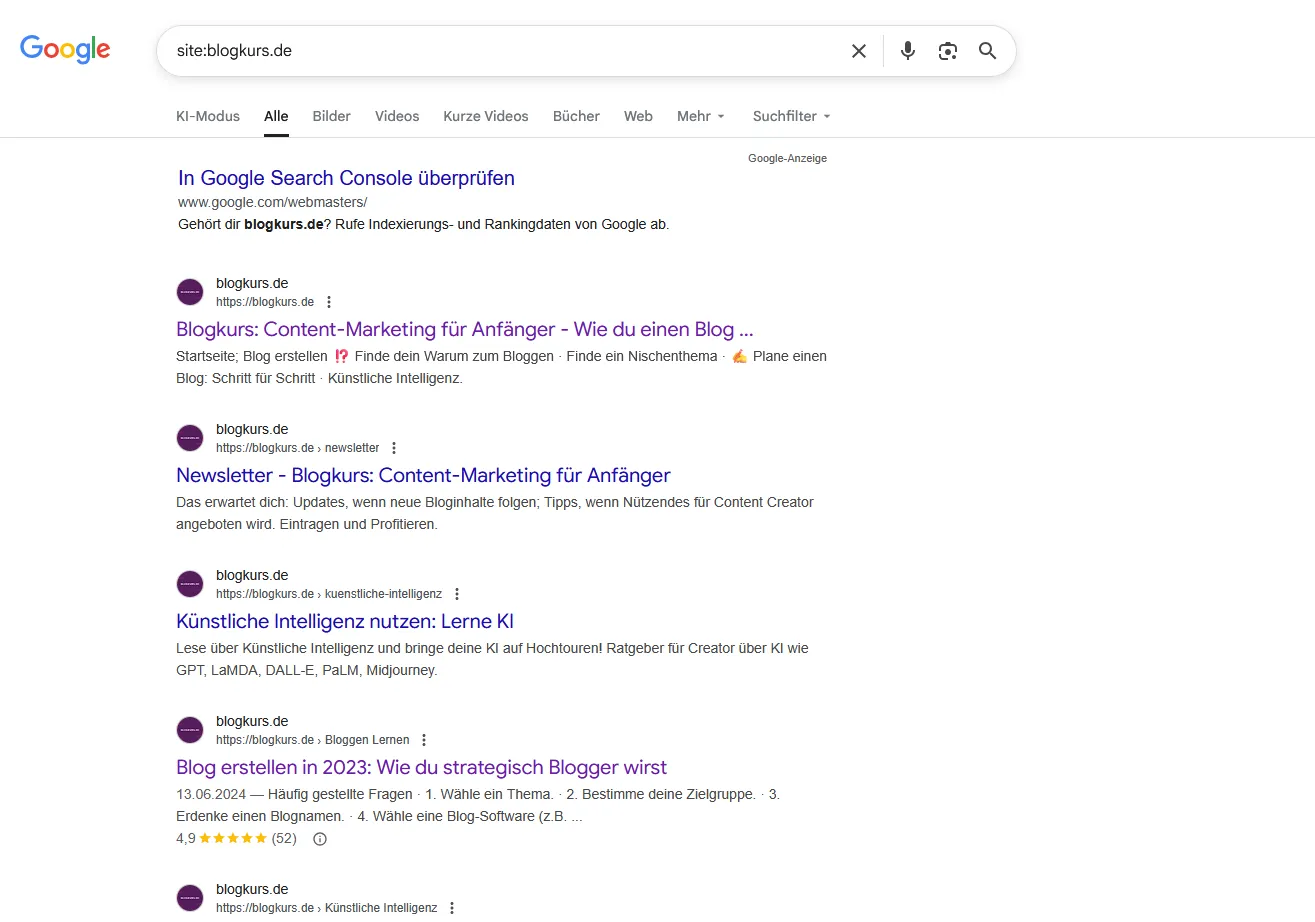

Site: Befehl in der Google Suche offenbart alle indexierten Seiten einer Domain.

Site: Befehl in der Google Suche offenbart alle indexierten Seiten einer Domain.

Beginne mit der Bestandsaufnahme. Ein einfacher Befehl im Suchschlitz liefert Gewissheit: site:deinedomain.de. Google zeigt dir hier die nackte Wahrheit des Index. Präzision braucht ein Cockpit. Die Google Search Console übernimmt diese Rolle. Sie ist die direkte Schnittstelle zum Googlebot. Hier analysierst du Crawling-Statistiken wie Vitalwerte.

robots.txt

Souveränität bedeutet jedoch auch, Grenzen zu ziehen. Nicht jeder Winkel deiner Architektur gehört ins Schaufenster. Die Datei robots.txt agiert als strategischer Wegweiser im Root-Verzeichnis. Sie schont dein Crawl-Budget. Suchst du absolute Diskretion für sensible Daten, ist das noindex-Tag dein Werkzeug (dazu später mehr).

# Weise alle Crawler an

User-agent: *

# Schütze dein Crawl-Budget (Beispiel für Admin-Bereiche)

Disallow: /admin/ Disallow: /tmp/ Disallow: /api/private/

# Zeige Google den Weg zu deiner Sitemap

Sitemap: https://promptbard.de/sitemap.xmlsitemap.xml

Eine Sitemap ist das Inhaltsverzeichnis deiner Website für Suchmaschinen. Sie hilft dem Googlebot, alle deine URLs effizient zu entdecken.

<?xml version="1.0" encoding="UTF-8"?>

<urlset xmlns="http://www.sitemaps.org/schemas/sitemap/0.9">

<url>

<loc>https://deinedomain.de/</loc>

<lastmod>2026-01-10</lastmod>

<changefreq>daily</changefreq>

<priority>1.0</priority>

</url>

<url>

<loc>https://deinedomain.de/blog/seo-lernen-guide-programmierer</loc>

<lastmod>2026-01-09</lastmod>

<changefreq>monthly</changefreq>

<priority>0.8</priority>

</url>

</urlset>Hier eine Erklärung der XML-Tags:

| XML Tag | Bedeutung | Nutzen für Google |

|---|---|---|

| `<urlset>` | Root-Element | Kapselt die gesamte Sitemap nach dem XML-Standard. |

| `<url>` | Eintrags-Container | Umschließt alle Informationen zu einer einzelnen URL. |

| `<loc>` | URL (Location) | Die absolute Web-Adresse der Seite. Muss konsistent sein. |

| `<lastmod>` | Letzte Änderung | Zeitstempel (YYYY-MM-DD). Signalisiert, wann Content neu gecrawlt werden sollte. |

| `<changefreq>` | Änderungsfrequenz | Hinweis (z.B. daily, monthly), wie oft sich der Inhalt vermutlich ändert. |

| `<priority>` | Priorität (0.0 - 1.0) | Interne Gewichtung deiner Seiten. 1.0 ist meist die Homepage. |

.htaccess & Redirects

Die .htaccess setzt harte Fakten. Sie ist das unsichtbare Nervenzentrum für Redirects und Sicherheitsregeln. Hier erzwingst du HTTPS und verhinderst Duplicate Content (www vs. non-www).

Jeder Umzug einer Unterseite braucht einen permanenten 301-Redirect. Ohne ihn lässt du Nutzer und Crawler vor einer 404-Mauer stehen und verlierst deine Rankings.

RewriteEngine On

# 1. Erzwinge HTTPS

RewriteCond %{HTTPS} off RewriteRule ^(.*)$ https://%{HTTP_HOST}%{REQUEST_URL} [L,R=301]

# 2. Permanent Redirect von alt auf neu (SEO-Gold)

Redirect 301 /alte-seite https://deinedomain.de/neue-seite

# 3. Verhindere Directory Browsing (Sicherheit)

Options -IndexesWichtig: Bei modernen Stacks wie NextJS nutzt du die next.config.js.

module.exports = {

async redirects() {

return [

{

source: '/alte-seite',

destination: '/neue-seite',

permanent: true, // Erzeugt den SEO-wichtigen 301-Status

},

]

},

}Wichtige HTTP-Status-Codes und ihre Erklärung

| Code | Name | Was passiert technisch? | SEO-Impact (Dev-Sicht) |

|---|---|---|---|

| `200` | OK | Request erfolgreich, Inhalt wird ausgeliefert. | Standard. Google indexiert die Seite. Alles grün. |

| `301` | Moved Permanently | Die Ressource liegt dauerhaft woanders. | Der SEO-Goldstandard. Leitet fast 100% des 'Linkjuice' auf die neue URL weiter. Pflicht bei Relaunches. |

| `302` | Found (Temporary) | Die Ressource ist nur kurzzeitig woanders. | Vorsicht. Google behält die alte URL im Index. Nutze das nur für echte temporäre Events. |

| `304` | Not Modified | Inhalt unverändert (Caching-Header). | Spart Crawl-Budget. Der Bot muss die Seite nicht neu laden. |

| `404` | Not Found | Ressource nicht gefunden. | Google wirft die Seite aus dem Index. Zu viele interne 404s signalisieren mangelnde Wartung. |

| `410` | Gone | Ressource dauerhaft und bewusst gelöscht. | Der schnelle Tod. Stärkeres Signal als 404. Sagt Google: 'Komm nie wieder'. Beschleunigt die De-Indexierung. |

| `500` | Internal Server Error | Server-seitiger Crash (Code-Fehler). | Ranking-Killer. Bei Häufung stuft Google die Seite als unzuverlässig ein. |

| `503` | Service Unavailable | Server überlastet oder in Wartung. | Der 'Pause-Knopf'. Google kommt später wieder und behält die Rankings bei (ideal für Deployments). |

Technisches Content-Engineering: Strukturiere Deine Inhalte für maximale Relevanz

Steht das Gerüst der Indexierung, übernimmt die Präzision im Detail die Regie.

<title>: Die Schlagzeile deiner Unterseite. Der wichtigste On-Page Faktor.- Meta Description: Teaser für die Suchergebnisse. Steuert die Klickrate (CTR).

- Headlines (H1-H6): Semantische Wegweiser, keine Gestaltungsmittel.

Und holst ihn mit Content ab, den du für Nicht-Techies geschrieben hast.

Live-Check: So sieht dieser Guide bei Google aus

Wichtige HTML-Elemente für SEO

Diese Elemente sollte jede Seite beinhalten:

| HTML Tag | SEO-Funktion | Best Practice für Devs |

|---|---|---|

| `<title>` | Wichtigster On-Page Faktor; wird in SERPs angezeigt. | Einzigartig pro Seite, max. 60 Zeichen, Keyword vorne. |

| `<html lang='...'>` | Legt die Sprache fest; wichtig für Screenreader & GEO-Targeting. | Immer setzen (z.B. lang='de'). Verhindert falsche Sprachzuordnung. |

| `<meta name='description'>` | Indirekter Faktor; steuert die Klickrate (CTR). | Zum Klicken anregen, max. 155 Zeichen, USP nennen. |

| `<h1>` | Hauptthema der Seite (Semantischer Anker). | Nur 1x pro URL verwenden; muss das Haupt-Keyword enthalten. |

| `<h2>` - `<h3>` | Gliederung und Themenrelevanz für Untersektionen. | Hierarchisch absteigend nutzen; keine Ebenen überspringen. |

| `<a>` | Crawling-Pfad und Autoritätstransfer (Linkjuice). | `href` nutzen (kein JS-onClick), sprechende Ankertexte. |

| `<img>` | Bildersuche und Barrierefreiheit. | Immer `alt`-Attribut setzen; beschreibend & prägnant. |

| `link rel='canonical'` | Verhindert Probleme mit Duplicate Content. | Auf die Original-URL verweisen, um URL-Varianten zu bündeln. |

Bist du Coder, baue interaktive Content-Teile wie Berechnungstabellen. Damit beschäftigst du den Leser und erhöhst die Verweildauer.

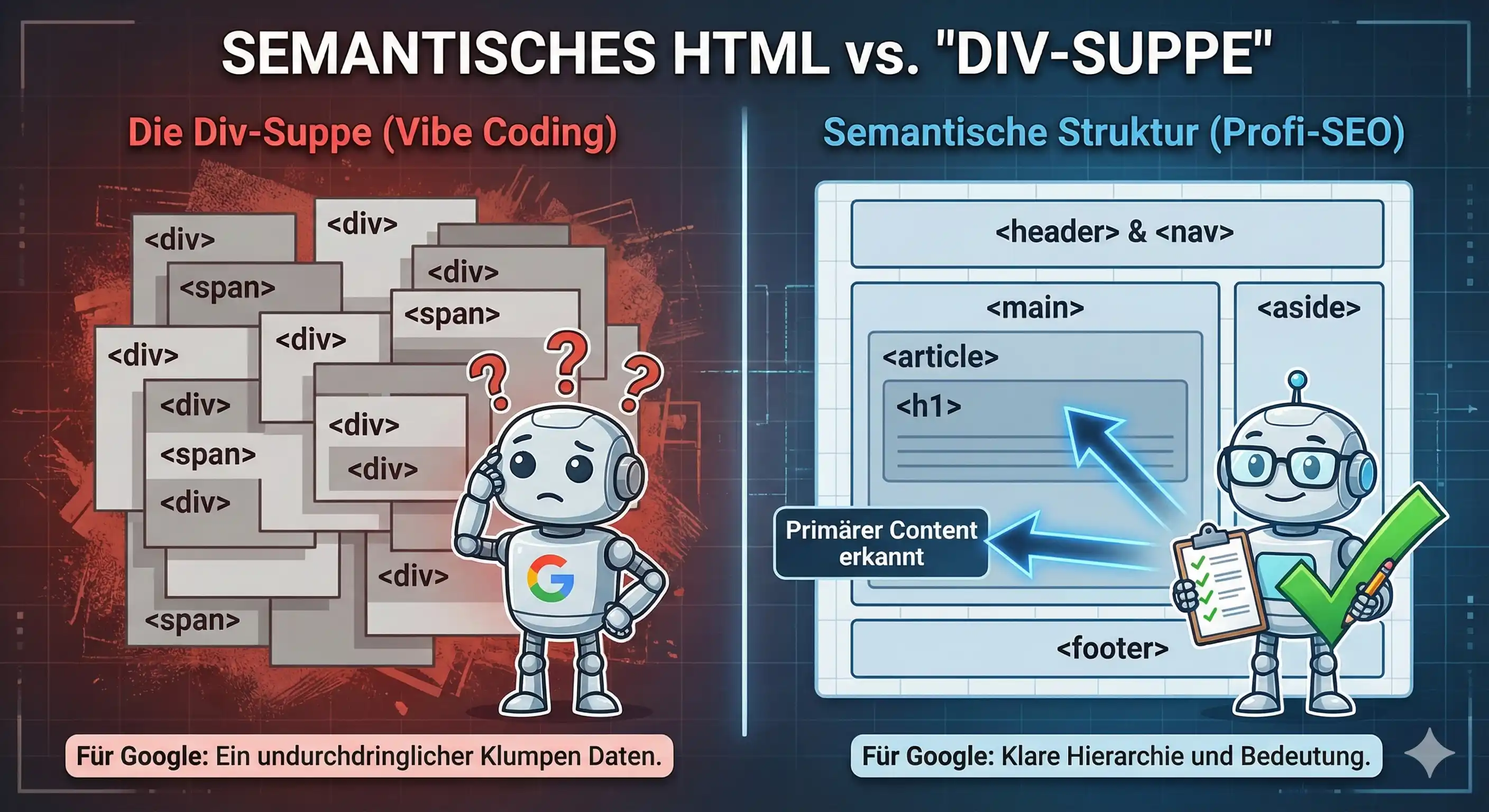

Infografik "Div-Suppe" gegen semantisches HTML. Grafik mit Gemini Pro erstellt.

Infografik "Div-Suppe" gegen semantisches HTML. Grafik mit Gemini Pro erstellt.

HTML5 Tags die wichtig sind und Struktur erklären

Semantisches HTML5 ist die Sprache, mit der du Google erklärst, wie dein Layout „funktioniert“. Statt generischen <div>-Süppchen nutzt du Tags, die eine klare Bedeutung haben.

| HTML5 Tag | Semantische Bedeutung | SEO & Accessibility Benefit |

|---|---|---|

| `<main>` | Zentraler Inhaltsbereich einer Seite. | Hilft Google, den Primär-Content sofort von Navigation oder Footer zu unterscheiden. |

| `<article>` | Eigenständiger, in sich geschlossener Beitrag. | Signalisiert, dass dieser Inhalt unabhängig geteilt werden kann (z.B. in News-Feeds). |

| `<section>` | Thematische Gruppierung von Inhalten. | Gibt dem Algorithmus klare Hinweise auf die Struktur deiner Argumentation. |

| `<nav>` | Bereich für Navigations-Links. | Ermöglicht Screenreadern das schnelle Finden der Navigation und markiert wichtige Link-Hubs. |

| `<aside>` | Inhalt mit indirektem Bezug zum Hauptthema. | Kennzeichnet Sidebar-Content oder Infoboxen. |

| `<header> / <footer>` | Einleitende bzw. abschließende Elemente. | Verbessert die Orientierung für Bots und Nutzer. |

| `<time>` | Maschinenlesbare Zeit- oder Datumsangabe. | Ermöglicht Google die präzise Extraktion von Veröffentlichungsdaten. |

| `<blockquote>` | Zitate. | Perfekt, um Expertenzitate optisch und semantisch abzuheben. |

| `<code> & <pre>` | Quellcode. | Wenn du für Coder schreibst, ist das dein wichtigstes Element. Google versteht dadurch, dass hier technisches Wissen vermittelt wird. |

Social Meta-Tags: OpenGraph

Diese Tags steuern, wie deine Seite aussieht, wenn sie geteilt wird. Ohne sie überlässt du das Thumbnail dem Zufall.

| Meta Tag | Bedeutung | Best Practice |

|---|---|---|

| `og:title` | Der Titel für Social Media. | Kann oft identisch mit dem `<title>` sein, darf aber reißerischer sein. |

| `og:description` | Die Kurzbeschreibung im Feed. | Fokus auf Neugier und Klick-Anreiz. |

| `og:image` | Das Vorschaubild (Preview Card). | Überlebenswichtig. 1200x630px. Muss sofort zeigen, worum es geht. |

| `og:type` | Definiert die Art des Contents. | Nutze `article` für Blogposts. |

| `twitter:card` | Spezielle Anzeige für X (Twitter). | Nutze `summary_large_image` für die maximale visuelle Präsenz. |

Accessibility und ARIA-Tags

Barrierefreiheit ist kein optionales Extra. Wer Barrieren abbaut, optimiert seine Seite nicht nur für Menschen, sondern verbessert gleichzeitig die Lesbarkeit für Suchmaschinen. Um die Brücke zu schlagen, wenn herkömmliches HTML an seine Grenzen stößt, kommen ARIA-Tags zum Einsatz.

<button

id="settings-button"

class="accordion-header"

aria-expanded="false"

aria-controls="settings-content"

>

Account-Einstellungen

</button>

<div id="settings-content" class="accordion-content" role="region" aria-labelledby="settings-button" hidden></div>| ARIA Tag / Attribut | Funktion | SaaS-Beispiel |

|---|---|---|

| `aria-label` / `aria-labelledby` | Gibt Elementen ohne sichtbaren Text einen Namen. | Icon-Button (Mülleimer): `aria-label='Eintrag löschen'`. |

| `aria-hidden` | Entfernt Elemente für Screenreader. | Dekorative Icons oder rein illustrative Grafiken. |

| `aria-expanded` | Zeigt den Status (open/closed) von Widgets an. | Sidebar-Navigation oder User-Profile Dropdown. |

| `aria-live` | Informiert über dynamische Inhalts-Updates (AJAX). | Statusmeldungen wie 'Änderungen gespeichert'. |

| `role` (z.B. `status`, `dialog`) | Definiert den Zweck eines Elements präzise. | Ein Modal benötigt `role='dialog'` für den Fokus-Fallen-Kontext. |

Gut zu wissen:

Das Barrierefreiheitsstärkungsgesetz (BFSG) verpflichtet Unternehmen ab dem 28. Juni 2025 dazu, digitale Produkte für alle Menschen zugänglich zu gestalten. Betroffen sind vor allem E-Commerce und SaaS-Anbieter. Wer die Frist verpasst, riskiert Bußgelder.

schema.org JSON-LD

Strukturierte Daten sind der Beipackzettel für deine Website. Ohne sie ist deine Seite nur Text; mit ihnen wird sie zu einem „Produkt“ oder „Event“.

{

"@context": "https://schema.org",

"@type": "Person",

"name": "Dein Name",

"url": "https://deinblog.de",

"jobTitle": "Fullstack Developer",

"sameAs": [

"https://github.com/deinusername",

"https://linkedin.com/in/deinusername"

]

}| Schema Typ | Was es bringt | Wichtige Properties |

|---|---|---|

| `SoftwareApplication` | Zeigt Preis, OS und Sterne-Bewertung deiner App direkt bei Google an. | operatingSystem, applicationCategory, offers, aggregateRating |

| `Article / BlogPosting` | Hilft Google, Autor und Datum besser zu verstehen. | headline, datePublished, author, image |

| `FAQPage` | Erzeugt ausklappbare Fragen und Antworten direkt in den Suchergebnissen. | mainEntity (Question & Answer) |

| `Organization` | Verknüpft deine Website mit Logo und Social-Media für den Knowledge Graph. | logo, url, sameAs |

| `Product` | Essenziell für E-Commerce. Zeigt Preis und Verfügbarkeit. | price, priceCurrency, availability, review |

| `BreadcrumbList` | Ersetzt die kryptische URL in den Suchergebnissen durch einen Pfad. | itemListElement, position, item |

| `HowTo` | Zeigt Schritte direkt in der Suche an. | step, totalTime, supply |

| `Person` | Verknüpft den Autor mit seinen Profilen (Expertenstatus). | name, jobTitle, sameAs, alumniOf, worksFor |

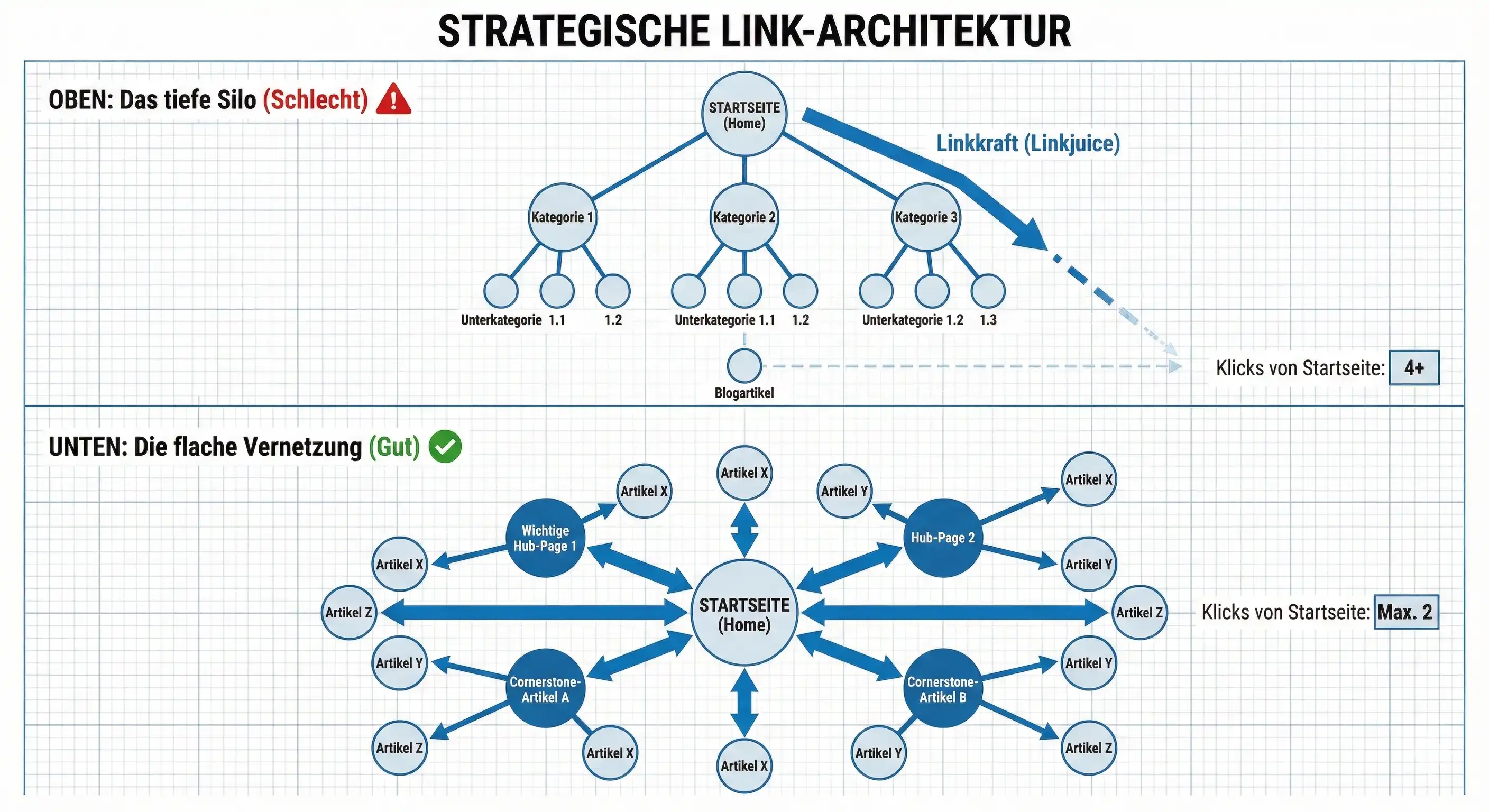

Strategische Link-Architektur: Leite Crawler gezielt

Links bilden das Nervensystem deiner Website. Nutze das klassische <a>-Tag mit href. Ein Linktext dient als Versprechen. „Hier klicken“ ist eine vertane Chance. Wähle Begriffe, die den Kern der Zielseite treffen.

Der Link-Text-Linter für Devs

Bevor du einen Link setzt, jage ihn durch diesen mentalen Debugger:

* Der Solo-Test: Ergibt der Link-Text (z.B. „Next.js Dynamic Routing Guide“) noch Sinn, wenn man den restlichen Satz löscht? * Image-Fallback: Fungiert ein Bild als Link? Google nutzt das alt-Attribut als Ankertext. * Semantische Dichte: Nutze Keywords natürlich im Text.

Strategische interne Verweise gewichten dein Angebot. Eine flache Hierarchie sorgt dafür, dass jede Information nur wenige Klicks entfernt ist.

Infografik über eine idealistische Link-Architektur. Grafik mit Gemini Pro erstellt.

Infografik über eine idealistische Link-Architektur. Grafik mit Gemini Pro erstellt.

E-E-A-T (laut Google)

In den letzten Jahren fokussierte Google sich von reinen Keywords auf Vertrauen (E-E-A-T).

| Buchstabe | Bedeutung | Dev-Übersetzung |

|---|---|---|

| E | Experience (Erfahrung) | Der 'Proof of Work'. Hast du das Tool wirklich benutzt? Zeigst du eigene Screenshots, Terminal-Outputs und echte Fehlermeldungen? |

| E | Expertise (Fachwissen) | Die theoretische Tiefe. Verstehst du, warum der Code so funktioniert? Kannst du Edge-Cases erklären? |

| A | Authoritativeness (Autorität) | Der Ruf in der Community. Verlinken StackOverflow, GitHub oder große Tech-Blogs auf dich? |

| T | Trustworthiness (Vertrauenswürdigkeit) | Sicherheit und Transparenz. Wer steckt hinter der Seite? Ist die Seite sicher (HTTPS)? T gilt als der wichtigste Faktor. |

Ohne Backlinks bringt dir E-E-A-T jedoch wenig.

YMYL: Wenn Google den "Strict Mode" aktiviert

Sobald deine Seite Themen berührt, die Gesundheit, Finanzen, Sicherheit oder Recht behandeln (Your Money Your Life), schaltet der Algorithmus in den Strict Mode.

| Bereich | Klassische Beispiele | SaaS-Kontext (Oft übersehen) |

|---|---|---|

| Finanzen | Banking, Kredite. | Rechnungstools, Checkout-Prozesse, Krypto-Dashboards. |

| Gesundheit | Krankheiten, Ernährung. | Fitness-Tracker, Apps für mentale Gesundheit, Ergonomie. |

| Recht & Civic | Gesetze. | DSGVO-Generatoren, Steuer-Rechner, Visa-Antrags-Hilfen. |

| Sicherheit | Notfall-Infos. | Cybersecurity-Tools, Passwort-Manager. |

Backlinks & Autorität

Das Web ist ein Netz. Ein Backlink ist technisch gesehen ein Zitat – eine digitale Bürgschaft für deine Qualität. Ohne Backlinks bleibst du ein unbestätigtes Gerücht.

Creative Engineering: Link-Building durch Code

Vergiss das Betteln um Links („Cold Outreach“). Als Entwickler hast du einen unfairen Vorteil: Du kannst Assets erschaffen, die so nützlich sind, dass Leute freiwillig darauf verlinken.

- Micro-SaaS als Link-Magnet: Code einen kleinen Rechner oder Konverter (z.B. CO2-Fußabdruck-Rechner). Tools werden tausendmal eher verlinkt als Artikel.

- Integrations-Partnerschaften: Baue Schnittstellen zu Slack oder Notion und lande in deren „App Directory“. Das sind Links mit extrem hoher Autorität (DR 80+).

- Data Journalism: Scrape Daten, analysiere Trends und visualisiere sie. Presse liebt Daten.

- Content Syndication: Veröffentliche Artikel auf Dev.to oder Hashnode (mit

rel="canonical"auf dein Original), um deren Autorität zu nutzen. - Der Open-Source-Hebel (NPM): Veröffentliche Helper-Functions auf NPM. Jedes nützliche Paket generiert Backlinks von Dutzenden Dokumentations-Crawlern.

- Google Business: Ein bestätigtes lokales Profil ist einer der stärksten Trust-Anker überhaupt.

| Methode | SEO-Ziel | Aufwand | Impact |

|---|---|---|---|

| Google Business | Trust & Local SEO | Einmalig | ⭐⭐⭐⭐⭐ (Must Have) |

| Dev.to / Hashnode | Traffic & Canonical | Pro Artikel 5 Min | ⭐⭐⭐⭐ |

| Indie Hackers / ProductHunt | SaaS-Kontext | Einmalig | ⭐⭐⭐⭐ |

| NPM Package | Tech-Authority | Einmalig (Code) | ⭐⭐⭐ (Profi-Move) |

| Expired Domain | Link-Juice | Aufwändig | ⭐⭐ (Nice-to-Have) |

Expired Domains als Backlink-Quelle

Eine Expired Domain ist eine Domain, die nicht verlängert wurde, aber noch Backlinks besitzt. Statt bei Null anzufangen, kaufst du dir ein gebrauchtes Fundament.

"Code-Review" für Domains:

- Archiv-Check: Nutze die Wayback Machine. War es Spam?

- Backlink-Audit: Wer verlinkt darauf?

- Index-Status: Ist die Domain noch bei Google bekannt (

site:domain.com)?

Google für Zuhause: Expired Domains (fast) automatisch finden

Die manuelle Suche ist mühsam. Mein Open-Source Tool Link Hunter (auf GitHub) automatisiert das. Es prüft Links nicht nur auf 404, sondern checkt DNS und WHOIS.

# depth=0: only the URLs in targets.txt

# depth=1: targets + one level of external hubs (e.g., GitHub Repos)

hunter = ExpiredLinkHunter(debug=False, max_depth=1) Der Hunter jagt. Console-Ausgabe des Python-Tools.

Der Hunter jagt. Console-Ausgabe des Python-Tools.

Schlechtes SEO vermeiden (Black-Hat)

Was du gänzlich vermeiden solltest nennt sich Black-Hat-SEO. Google straft diese Techniken gnadenlos ab.

| White Hat (Erlaubt) | Black Hat (Gefährlich) |

|---|---|

| Hochwertiger Content | Keyword Stuffing |

| Organische Backlinks | Gekaufte Spam-Links |

| Saubere technische Struktur | Unsichtbare Texte / Cloaking |

| Expired Domains mit Relevanz | Massen-Redirects fachfremder Domains |

Die größten Sünden:

- Backlinks kaufen: Der Algorithmus erkennt diese „Nachbarschaften“.

- Keyword Stuffing: Übertriebenes Aneinanderreihen von Keywords.

- Unsichtbarer Text: Weiße Schrift auf weißem Grund oder

display: none. - Mangelnde Sicherheit: Ein gehacktes CMS oder abgelaufenes SSL-Zertifikat sind SEO-Killer.

Hacks erkennen (Google Dork)

Prüfe, ob deine Seite gehackt wurde:site:deinedomain.com casino OR viagra OR poker OR "make money" Gehackte Wordpress-Seite.

Gehackte Wordpress-Seite.

Gehackte Wordpress-Seite Quellcode in Developer-Tools.

Gehackte Wordpress-Seite Quellcode in Developer-Tools.

Kostenlose Tools für deine SaaS-SEO-Strategie

- Google Search Console: Das wichtigste Tool überhaupt.

- PageSpeed Insights / Lighthouse: Misst die Core Web Vitals.

- Screaming Frog SEO Spider: Crawlt bis zu 500 URLs kostenlos. Findet 404s und fehlende Alt-Texte.

- SEO Minion / Detailed SEO: Browser-Extensions für den schnellen On-Page-Check.

- Schema Builder: Chrome Extension zum Erstellen von JSON-LD.

- SEO Data Wizard Monitoring Mobile App für Audits und Rank-Tracking.

UX als Erfolgsfaktor: Core Web Vitals

Google misst heute nicht mehr nur, ob eine Seite lädt, sondern wie sie sich beim Laden anfühlt.

| Metrik | Name | Was es wirklich bedeutet |

|---|---|---|

| LCP | Largest Contentful Paint | Ladegeschwindigkeit. Wie lange dauert es, bis das größte Element (Hero-Image) da ist? Ziel: < 2,5s. |

| INP | Interaction to Next Paint | Reaktionszeit. Misst, wie schnell die Seite auf Klicks reagiert. Wenn JS den Main-Thread blockiert, fühlt sich die Seite tot an. |

| CLS | Cumulative Layout Shift | Visuelle Stabilität. Springen Elemente während des Ladens? Der Endgegner der UX. Ziel: nahe 0. |

Häufige Fragen zu Technical SEO für Entwickler

Performance (Core Web Vitals) ist nur eine Säule. Google muss deine Inhalte auch verstehen. Ohne semantisches HTML, strukturierte Daten (Schema.org) und eine logische Link-Architektur weiß der Bot zwar, dass deine Seite schnell lädt, aber nicht, für welche spezifischen Probleme du die Lösung bietest.

Die robots.txt ist eine 'Zutrittsverbot'-Empfehlung für den Crawler (Crawl-Steuerung). Ein 'noindex'-Tag im HTML-Header hingegen ist der explizite Befehl, eine Seite nicht in den Suchergebnissen anzuzeigen (Index-Steuerung). Wichtig: Google muss eine Seite crawlen können, um das noindex-Tag überhaupt zu sehen!

Nicht zwangsläufig, aber es macht es Google schwerer. Googlebot kann JavaScript rendern, braucht dafür aber zwei Durchläufe ('Two-Wave Indexing'). Das verzögert die Indexierung. Für SEO-kritische Seiten solltest du immer auf Server-Side Rendering (SSR) oder Static Site Generation (SSG) wie bei Next.js oder Astro setzen.

Nutze das 'URL-Prüfung'-Tool in der Google Search Console. Klicke auf 'Live-URL testen' und schau dir den gerenderten HTML-Code und den Screenshot an. Wenn dort wichtige Inhalte fehlen, hast du ein Rendering-Problem.

Ja, sie sind die 'Währung' des Internets. Ein technisches SEO-Setup sorgt dafür, dass du nicht disqualifiziert wirst, aber Backlinks (Autorität) sorgen dafür, dass du gewinnst. Für Techies sind NPM-Pakete, GitHub-Repos und Gastbeiträge auf Developer-Plattformen die ehrlichsten Wege, Autorität aufzubauen.

Ein Soft 404 liegt vor, wenn eine Seite 'Nicht gefunden' anzeigt, der Server aber den HTTP-Status 200 (OK) sendet. Google denkt dann, die Fehlerseite sei wertvoller Inhalt. Das verschwendet Crawl-Budget und führt zu 'Thin Content'-Warnungen. Sende immer einen echten 404- oder 410-Header.

Indirekt ja. Google nutzt Barrierefreiheits-Signale als Qualitätsmerkmal. Da Bots ähnlich wie Screenreader auf semantisches HTML angewiesen sind, führt eine Optimierung für Menschen mit Behinderungen fast immer zu einer besseren Lesbarkeit für Suchmaschinen.